论文1(ResNet)

#论文阅读#ResNet

《Deep Residual Learning for Image Recognition》阅读笔记

论文链接

https://arxiv.org/pdf/1512.03385

代码链接

无

作者信息

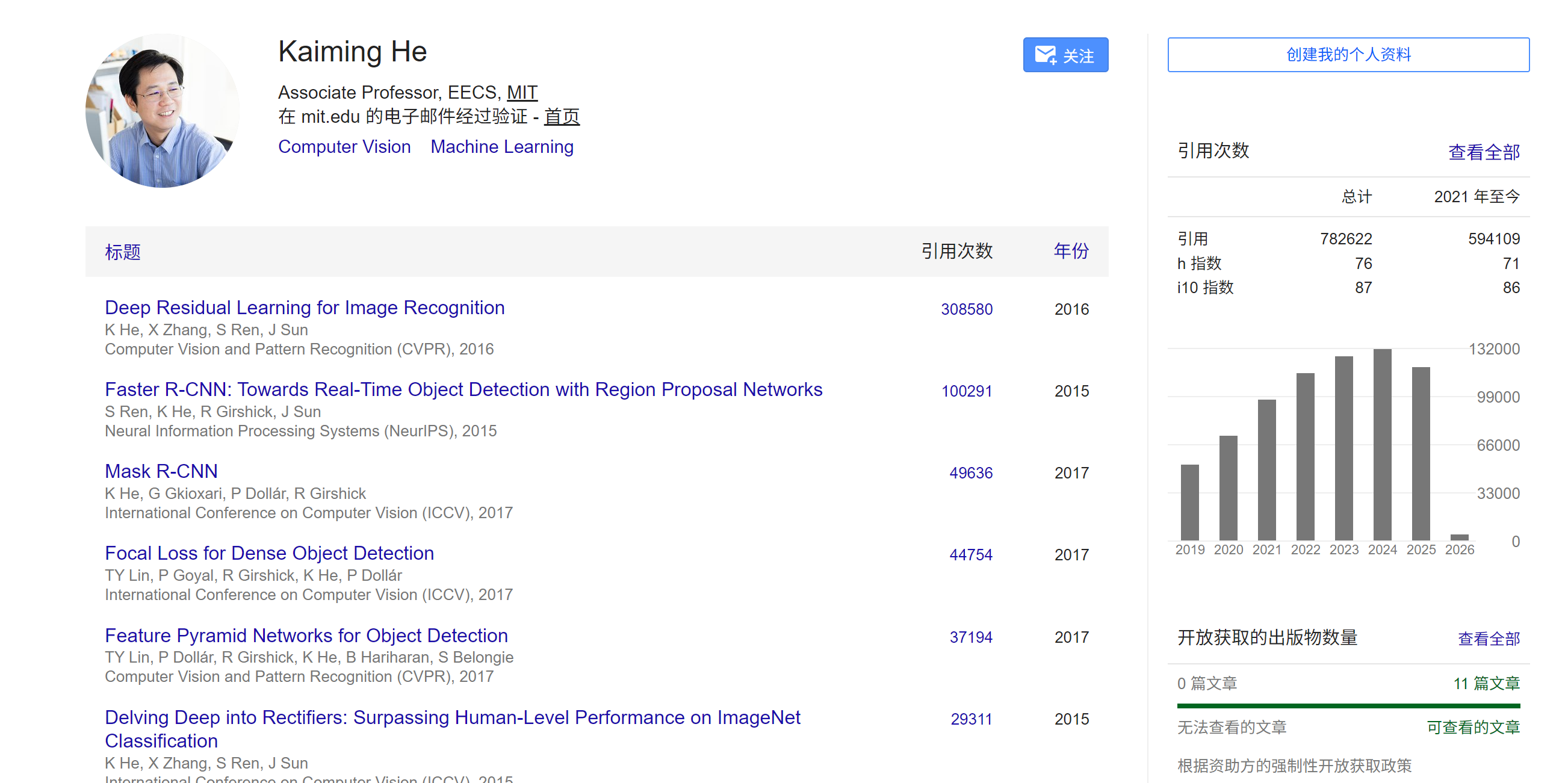

Kaiming He

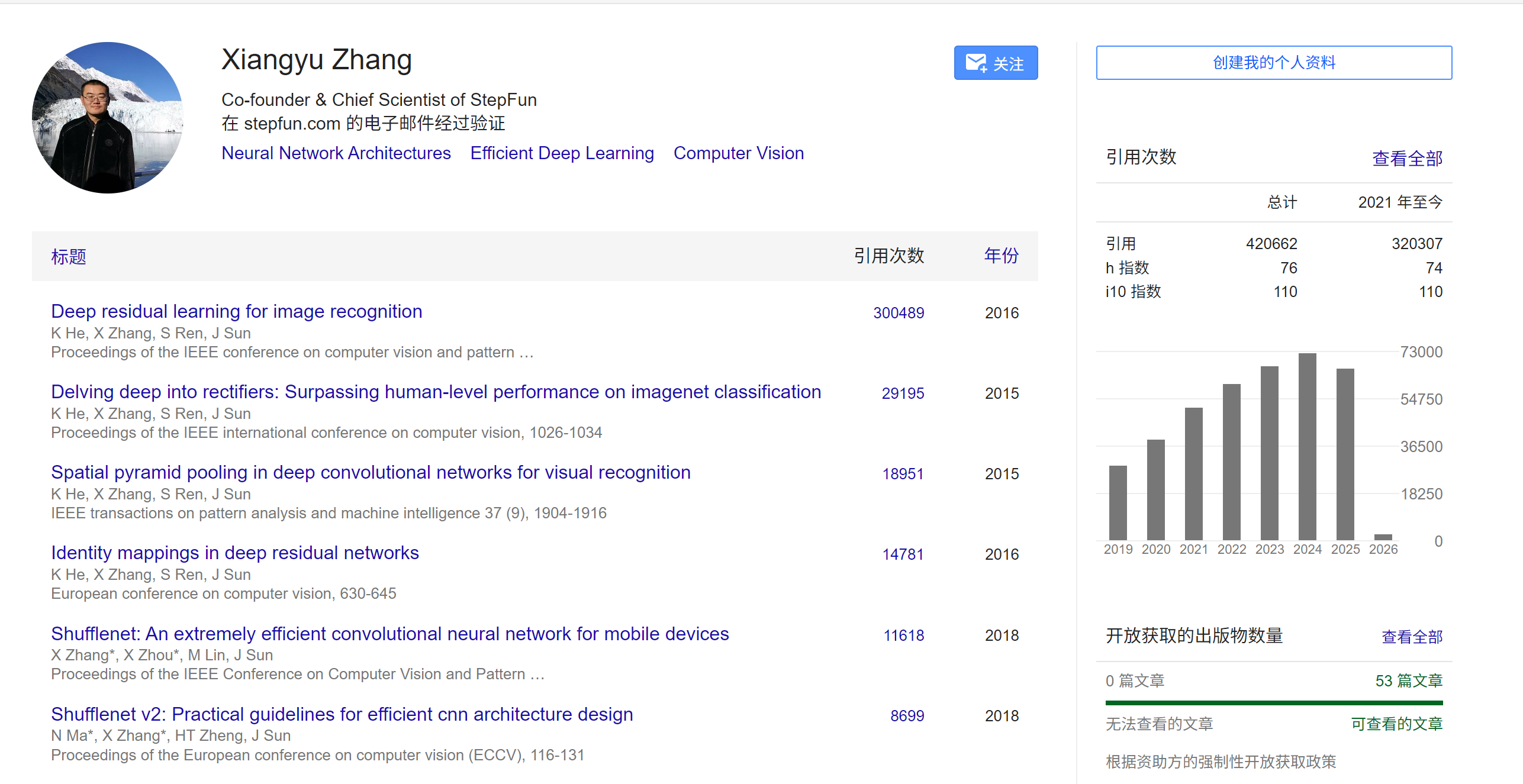

Xiangyu Zhang

Xiangyu Zhang

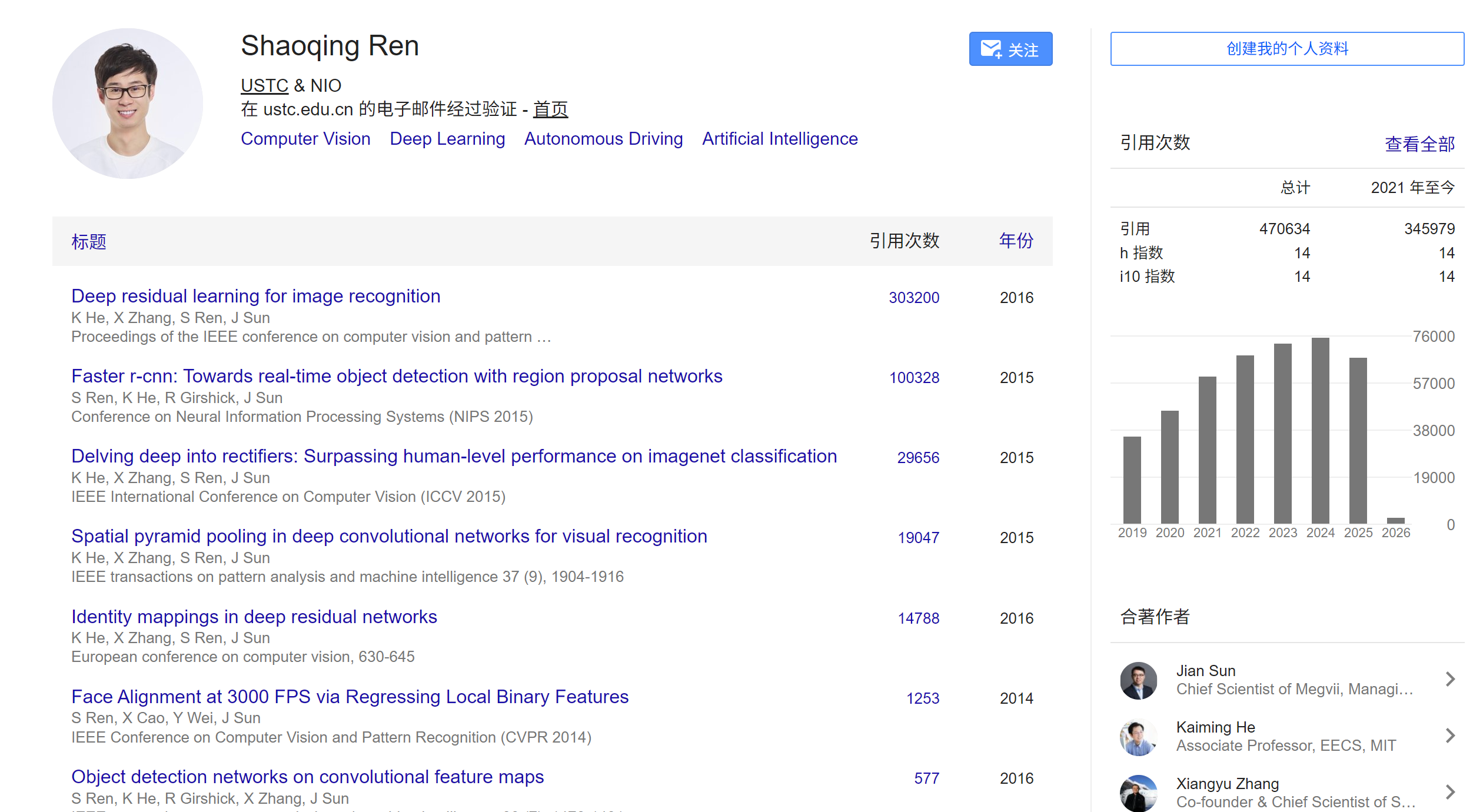

Shaoqing Ren

Shaoqing Ren

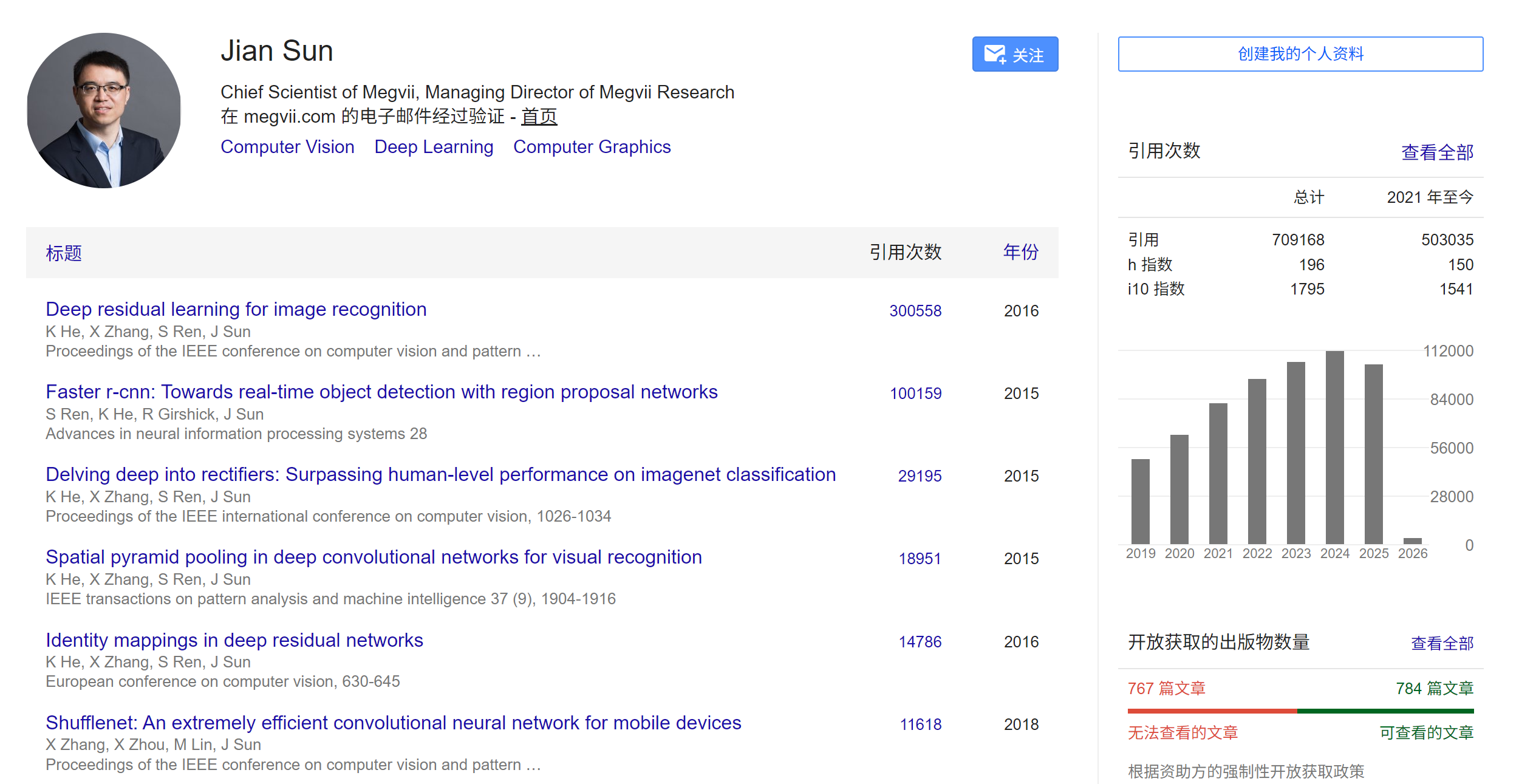

Jian Sun

Jian Sun

1. 背景

- 研究领域:计算机视觉中的图像识别

- 问题定义:随着卷积神经网络层数的增加,模型本应通过学习更丰富的多尺度特征提升性能,但实际训练中会出现“退化问题”(Degradation Problem),这并非由过拟合导致,而是由于深层网络的优化难度急剧增加,传统网络架构难以应对这一挑战; 传统深层网络还存在梯度消失问题,进一步阻碍了模型的有效训练。

- 相关工作:AlexNet、VGGNet、GoogLeNet验证了深度的价值,但未解决退化问题;ReLU、BN等方法仅缓解梯度消失,无法解决退化。

2. 动机

- 研究问题:控制参数量的基础上解决深层网络退化、同时优化梯度传播,实现超深层网络高效训练。

- 贡献:提出残差学习框架,设计残差块(基础块、瓶颈块)和恒等跳跃连接,解决退化问题。

- 实际应用:实现152层网络训练,在ImageNet数据集错误率3.57%,成为后来深度学习架构的核心。

3. 方法

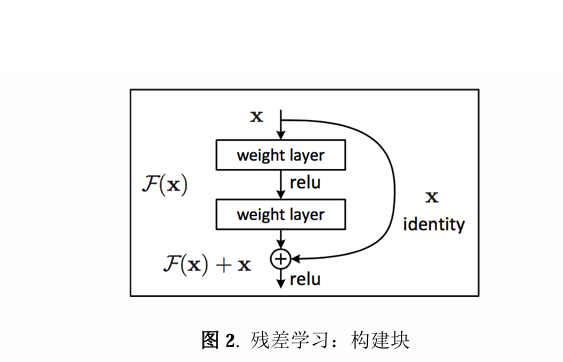

- 模型/算法/框架:残差块(基础块:2个3×3卷积;瓶颈块:1×1→3×3→1×1卷积,控制计算量);跳跃连接(默认方案B,维度匹配用恒等映射,不增加参数量,实现梯度无损传播)。

残差网络核心为残差映射 H(x)=x+F(x) 。

当网络层数过多时,模型可以轻松学到 “恒等映射”(即 F(x)=0,输出等于输入),避免了深层网络性能退化的问题。

当网络层数过多时,模型可以轻松学到 “恒等映射”(即 F(x)=0,输出等于输入),避免了深层网络性能退化的问题。 - 假设与前提:学习残差映射比完整映射更易优化,跳跃连接可实现梯度无损传播。

- 创新点:将网络学习目标从“完整映射”改为“残差映射”H(x)=x+F(x),学习残差更易优化。提出残差链接,残差链接的作用就是把之前学习到的特征拿过来,既解决梯度消失问题,还保证了即使最差情况下(模型什么都没学到)至少还能把上一层学习到的特征继续往更深的网络中传递,利用特征复用,解决网络的退化问题

4. 实验

- 数据集:ImageNet(分类)、CIFAR-10、COCO。

- 实验设置:训练超深层ResNet,验证残差结构有效性。

- 结果与分析:

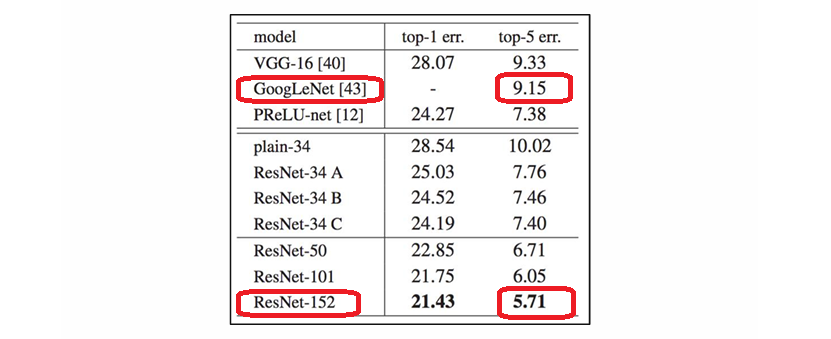

残差网络成功解决退化问题,深度增加性能提升;

ResNet-152性能远超GoogLeNet等模型

跳跃连接是核心,瓶颈块提升深层网络效率。

跳跃连接是核心,瓶颈块提升深层网络效率。

- 比较基准:GoogLeNet等

5. 消融实验

- 消融实验设计:验证跳跃连接、残差块类型、网络深度等对性能的影响。

- 消融结果:跳跃连接是解决退化的关键,瓶颈块适配超深层,深度需合理选择。

- 启示:BN、ReLU与残差连接协同,保障超深层网络稳定训练。跳跃连接是解决退化的关键,瓶颈块更适合超深层网络。

6. 思考 / 评论

- 方法的优缺点:优点: 彻底解决退化问题,实现超深层训练并且结构简洁,兼顾性能与计算量,实用性强。 缺点: 无明显缺点

- 论文的局限性:无明显局限性

- 未来方向:进一步优化残差结构,适配更多复杂图像任务

- 实际意义与潜力:为超深层神经网络设计提供范式,推动图像识别及下游任务发展。